Nous avons tous l’expérience de déambulations sur la Toile qui, de fil en aiguille, nous conduisent vers des sites où figurent des contributions plus surprenantes les unes que les autres et ce quels que soient les domaines justifiant les recherches que nous effectuons. Parfois, la surprise fait rire à gorge déployée mais, trop souvent, elle provoque la consternation voire l’indignation ; c’est le cas lorsqu’il s’agit de colporter de la fake science relevant du charlatanisme qui, selon le dictionnaire Larousse, est l’art d’abuser de la crédulité publique.

Il y a quelques années, j’ai été impliqué en tant que physicien pour donner un avis sur ce que certains appellent la médecine quantique. J’ai fait part de mon expérience dans un article de ce blog, voir “Le code le la route est-il quantique ?”.

Relation de cause à effet ou hasard de l’existence, me voici à nouveau dans l’obligation de me confronter au domaine des médecines parallèles — pardon des “thérapies complémentaires” puisqu’il ne faut froisser personne. J’aurai peut-être l’occasion de décrire ailleurs l’expérience inédite pour moi qui m’aura conduit à écrire ces quelques lignes.

Que la théorie quantique soit récupérée par des humoristes qui savent avec talent nous faire pénétrer dans le monde de ses extravagances, on ne peut que s’en réjouir : après tout n’est-ce pas là faire œuvre d’une vulgarisation de bon aloi sans se prendre au sérieux et sans jouer les pseudo-savants ? En revanche, qu’elle soit invoquée à tort et à travers par des “conférenciers” qui n’en connaissent visiblement pas le premier mot et l’utilisent à tort et à travers en affirmant n’importe quoi relève à proprement parler du scandale puisque cela revient à compter sur l’ignorance du public pour déverser sans risque immédiat des torrents d’inepties.

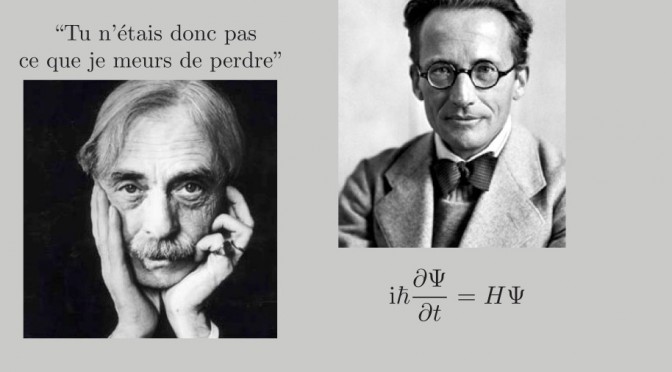

Le hasard m’a permis de tomber sur une vidéo (https://www.youtube.com/watch?v=wGKKBYHN5-Y ) enregistrée lors d’un congrès récent à Montpellier au titre aguicheur, “Santé de demain”, conférence étrangement intitulée “La pensée de l’homme créait elle ses maladies ? (et inversement ?!)” (pourquoi cet imparfait ?) ; l’orateur (homéopathe de profession, tiens, tiens, mais aussi auto-proclamé “pionnier de l’imagerie électro-photonique“) y accumule les âneries et les erreurs les plus grossières devant un auditoire visiblement muet d’admiration. Un florilège : à 32’11, il parle des photons UV qui “circulent à la longueur d’onde de 400 nm/s” sans omettre heureusement de préciser qu’il s’agit de nanomètres par seconde (tout le monde doit savoir ce qu’est un nanomètre !) — ou comment une longueur devient une vitesse ! Un futur bachelier qui écrirait cela à l’épreuve de physique mériterait 0/20. Mais ce n’est qu’un début : à propos de “corps énergétique” (qu’est-ce donc ???), il invoque Schrödinger (36’04), l’intrication et le paradoxe EPR. Gageons que la téléportation quantique ne fait pas encore partie du bagage intellectuel de ce grand savant, mais il faut sans doute s’en réjouir : quelles divagations ne lui inspirerait-elle pas ?

Pire que tout, et c’est là que, selon Larousse il est légitime de parler de charlatanisme à l’état brut : à l’appui des stupidités proférées devant un auditoire qui l’applaudira à tout rompre à la fin, l’orateur en appelle (47’58) aux travaux d’un certain Claude Louis Kervran en présentant ce dernier comme le lauréat du prix Nobel de physique 1979, excusez du peu.

Ce nom ne me disant strictement rien, j’ai cherché. Aucune trace de ce Claude Louis Kervran sur la Toile, mais après quelques efforts on finit par trouver un dénommé Corentin Louis Kervran dont les travaux, considérés comme de la pseudo-science, lui ont valu la suprême gloire : l’attribution du prix… Ig Nobel en 1993 ! Et ce `“for his conclusion that the calcium in chickens’ eggshells is created by a process of cold fusion”. On se doit de conseiller à l’orateur, une fois qu’il aura assimilé les bases de la théorie quantique, de reprendre à zéro sa documentation afin de ne pas accumuler les erreurs factuelles.

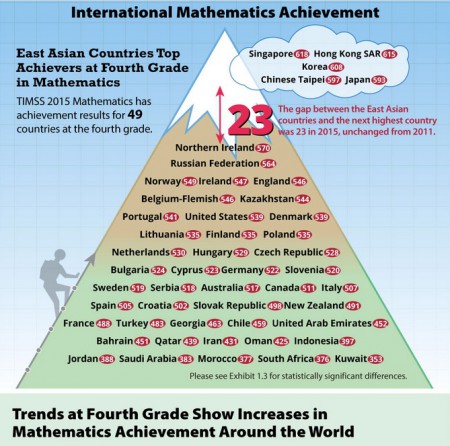

Il ne s’agit que d’un exemple, car on remplirait les volumes d’une encyclopédie à compiler les divagations de bonimenteurs de tout poil que l’on peut trouver sur la Toile, pas seulement à propos de la théorie quantique d’ailleurs car les mathématiques ne sont pas non plus épargnées : combien d’exposés prétendant offrir des démonstrations de conjectures auxquelles les mathématiciens se confrontent depuis des siècles ?

La vanité d’une compilation qui se voudrait exhaustive ne doit pas empêcher de dénoncer un exemple déniché par hasard parmi une multitude. Assez de ces prétendus orateurs qui jouent avec l’incapacité de leur public, faute d’une formation adéquate, à accueillir avec sens critique un délire verbal sans queue ni tête qui fait ressembler de telles interventions à la grand messe d’une secte célébrée par un gourou illuminé. Assez de ces congrès-bidons financés d’une façon ou d’une autre par les deniers publics qui contribuent à l’engraissement du compte en banque d’ignorants sans talent et d’éditeurs si peu regardants qu’ils se transforment en marchands de soupe. Assez de ces colloques réunissant les “plus grands experts internationaux” dont la seule expertise est l’art consommé de l’escroquerie intellectuelle et dont la seule internationale est celle des charlatans. Assez de ces péroraisons pontifiantes et creuses dont la profusion entretient le public dans l’ignorance et fait naître la tentation de l’anti-science qui mène tout droit à l’obscurantisme.